MicroNet Challenge는 NeurIPs2019에서 주최된 Large-Scale Model의 경량화를 위한 Competition임. 예를 들어, ImageNet에서 정확도 75%이상이 나오는 모델들 중에서 파라미터 수와 1개 이미지의 예측을 위해 필요한 연산 수를 최소화하는 것임. 대회 구성 주최원들은 아래와 같음.

- Google: Trevor Gale, Sara Hooker, Cliff Young, Utku Evci, Niki Parmar, Ashish Vaswani.

- DeepMind: Erich Elsen, Olivier Temam.

- OpenAI: Scott Gray.

- Facebook: Jongsoo Park.

Motivation

Large-scale model compression competition focused on efficient inference and future hardware. Contestants compete to design the most efficient models that solve the target task to the specified quality level.

Scoring

Their target metric is decoupled from existing hardware to incentivize exploration. Parameter storage & math operations normalized by state-of-the-art baseline. Sparsity, quantization taken into account.

Score = (parameter storage / baseline parameters) + (math operations / baseline ops)

Competition Tracks

- ImageNet: Image classification 1.28M/50K train/dev images 75% top-1 accuracy.

- WikiText-103: Language Modeling 217K/245K train/dev words 35 test perplexity.

- CIFAR-100: Image classification 50K/10K train/dev images 80% top-1 accuracy.

What we do

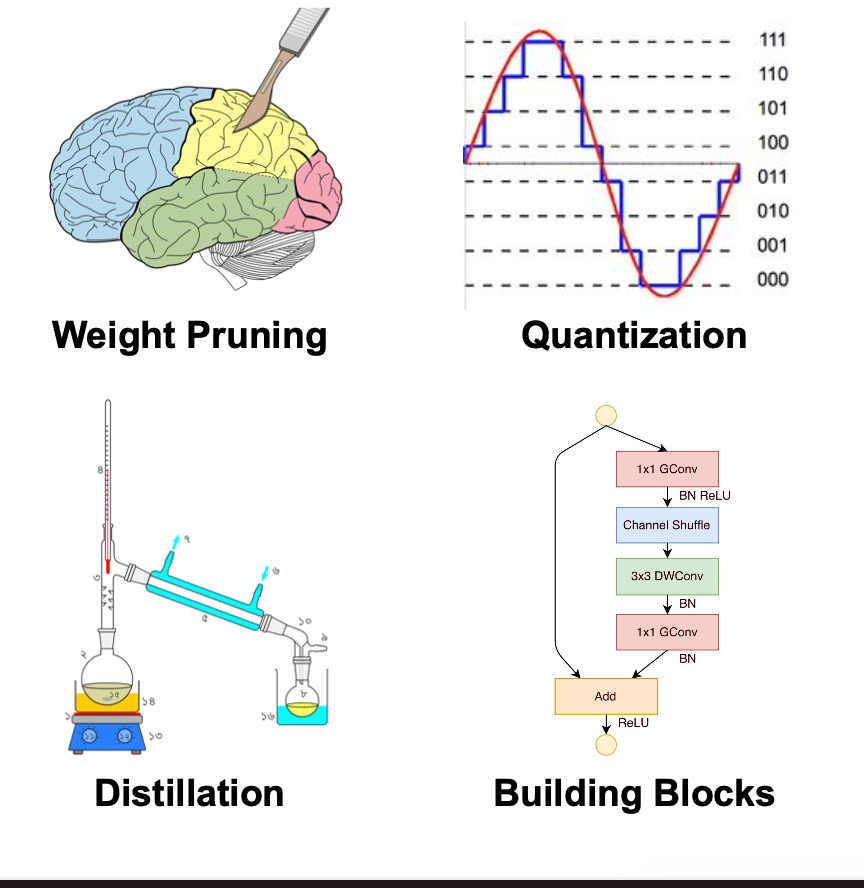

우리는 CIFAR-100 Track에 임하여서 여러 가지 trick들을 접목하여서 모델의 경량화 score를 0.0054점 얻을 수 있었고, (baseline의 점수는 2점) 최종 등수에서 2등과 3등을 동시에 할 수 있었다. 아래는 우리가 사용한 기술들이다. 더욱 자세한 내용은 우리의 Proceeding을 참고하길 바람. 대회 등수는 링크에서 확인가능함.

- Grid Search for model Architecture: number of channels, stride, number of blocks, kernel size.

- Orthogonality Regularization

- Adaptive Label Smoothing

- Cutmix

- Hard Swish

- Lottery Ticket Hypothesis

위를 구현한 코드는 github에 구현하여 둠.

Official code for team KAIST AI: github.com/Kthyeon/micronet_neurips_challenge

Kthyeon/micronet_neurips_challenge

MicroNet Challenge hosted at NeurIPs 2019. Contribute to Kthyeon/micronet_neurips_challenge development by creating an account on GitHub.

github.com

대회 홈페이지: micronet-challenge.github.io/

대회 트위터: twitter.com/unet_challenge

Source: groups.google.com/g/micronet-challenge/c/kGX40C9II1s

'대학원 > 작업물 (Works)' 카테고리의 다른 글

| NeurIPS2020 Black-Box Optimization 8th rank (0) | 2021.03.01 |

|---|