출처: www.aitimes.kr/news/articleView.html?idxno=18892

[AI 리뷰] 오픈AI, 글 쓰는 GPT-3에서 진화... 텍스트 읽고 그림 그리는 AI 모델 'DALL·E' 및 'CLIP' 공개 -

딥러닝이 컴퓨터 비전에 혁명을 가져 왔지만 현재, 접근 방식에는 몇 가지 주요 문제가 있다고 한다. 일반적인 이미지 데이터 세트는 노동 집약적이고 수집 및 가공하는 데 많은 비용이 많이 들

www.aitimes.kr

Computer Vision과 NLP가 결합된 모델. 텍스트를 인식해 이미지를 생성하고 이미지를 각각 카테고리로 분류할 수 있는 2가지 새로운 AI 모델.

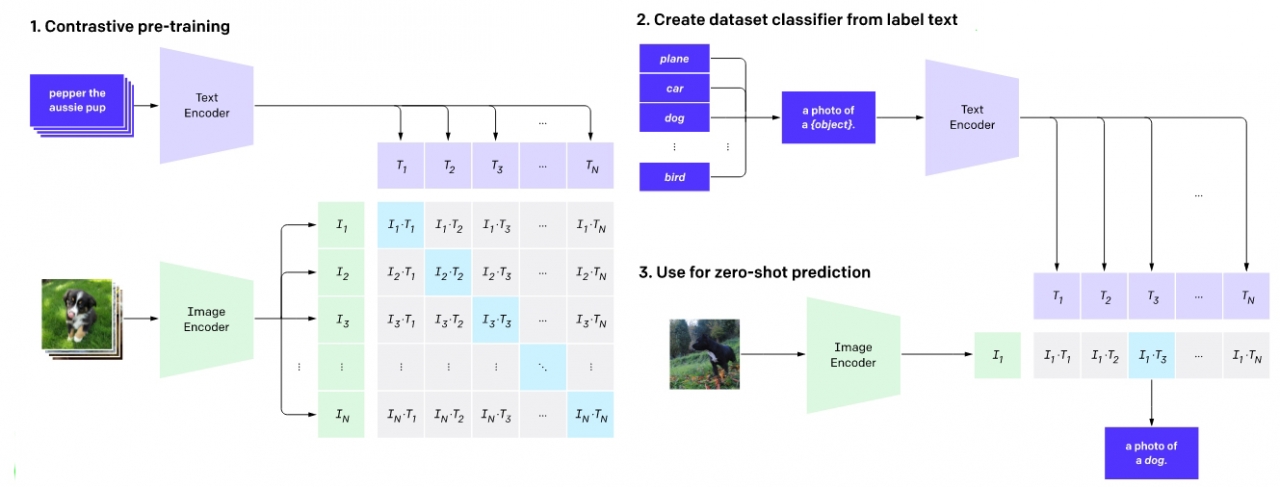

- OpenAI가 Computer vision과 NLP 기술을 결합해, 제시된 텍스트를 인식해 이미지를 생성하고 이미지를 각각 카테고리로 분류함. CLIP; Contrastive Language-Image Pre-training 과 DALL-E 공개함.

- 텍스트 입력에 따라 다양하고 때로는 초현실적인 이미지를 만듬. 예를 들어, '개와 산책하는 투투(발레 치마)의 아기 무' 그림 또는 '하프로 만든 달팽이' 등.

DALL-E

- DALL-E는 텍스트와 이미지를 바꾸고 AI가 반쯤 완성된 이미지를 완성하도록 훈련시켜 Image GPT를 구현한 것임.

- 동물이나 사물의 이미지를 인간 시각적으로 표현할 수 있으며, 관련 없는 아이템을 감각적으로 결합하여 하나의 이미지로 만들어 낼 수도 있음. Texture까지도 세심하게 표현함.

- '거북으로 만든 기린'이나 '아보카도 모양의 안락의자'에 대해서도 만족스러운 결과를 제공함.

CLIP

- 인터넷에서 이용할 수 있는 다양한 자연어 감독(Supervision)에 대해 훈련됨.

- CLIP은 데이터 세트에서 레이블이 지정된 단일 단어가 아닌 그림에 상세한 설명이 있는 것을 학습함.

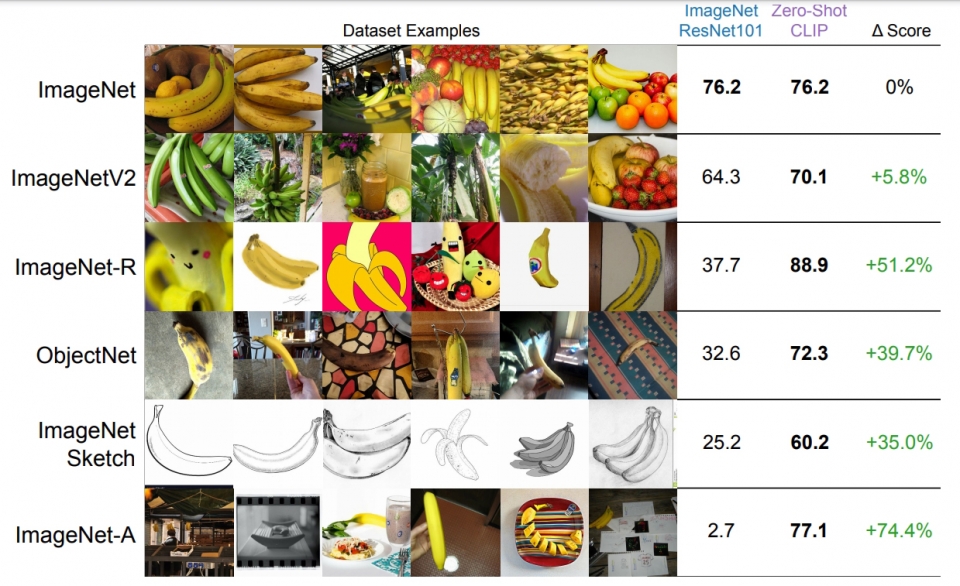

- Zero-shot learning 기능과 유사한 벤치 마크의 최적화 없이 다양한 분류 task를 수행하도록 지시함.

- OpenAI는 이러한 모델이 특정 직업에 대한 경제적 영향, 모델 출력의 편향 가능성 및 이 기술에 의해 암시되는 장기적인 윤리적 도전과 같은 사회적 문제와 어떻게 관련되는지 분석할 것이라고 밝힘.

출처 논문: cdn.openai.com/papers/Learning_Transferable_Visual_Models_From_Natural_Language_Supervision.pdf

Open sourcecode: github.com/openai/CLIP

openai/CLIP

Contrastive Language-Image Pretraining. Contribute to openai/CLIP development by creating an account on GitHub.

github.com

'Archive > News' 카테고리의 다른 글

| Facebook AI, On-device AI 플랫폼 'Detectron2Go' 오픈 소스로 공개 (0) | 2021.03.06 |

|---|---|

| LG CNS: 코딩 없이 프로그램 개발 도와주는 '데브온 NCD' 무료 공개 (0) | 2021.03.02 |

| Facebook AI 다국어 음성 AI 개발을 위한 오픈소스 데이터 셋 공개 (0) | 2021.02.28 |

| 제 4회 국제인공지능대전(AI EXPO KOREA) (0) | 2021.02.24 |

| 구글 AI, 플랫폼 '모델 서치' 오픈 소스로 공개 (0) | 2021.02.24 |